19:32 Когда алгоритм становится судьёй |

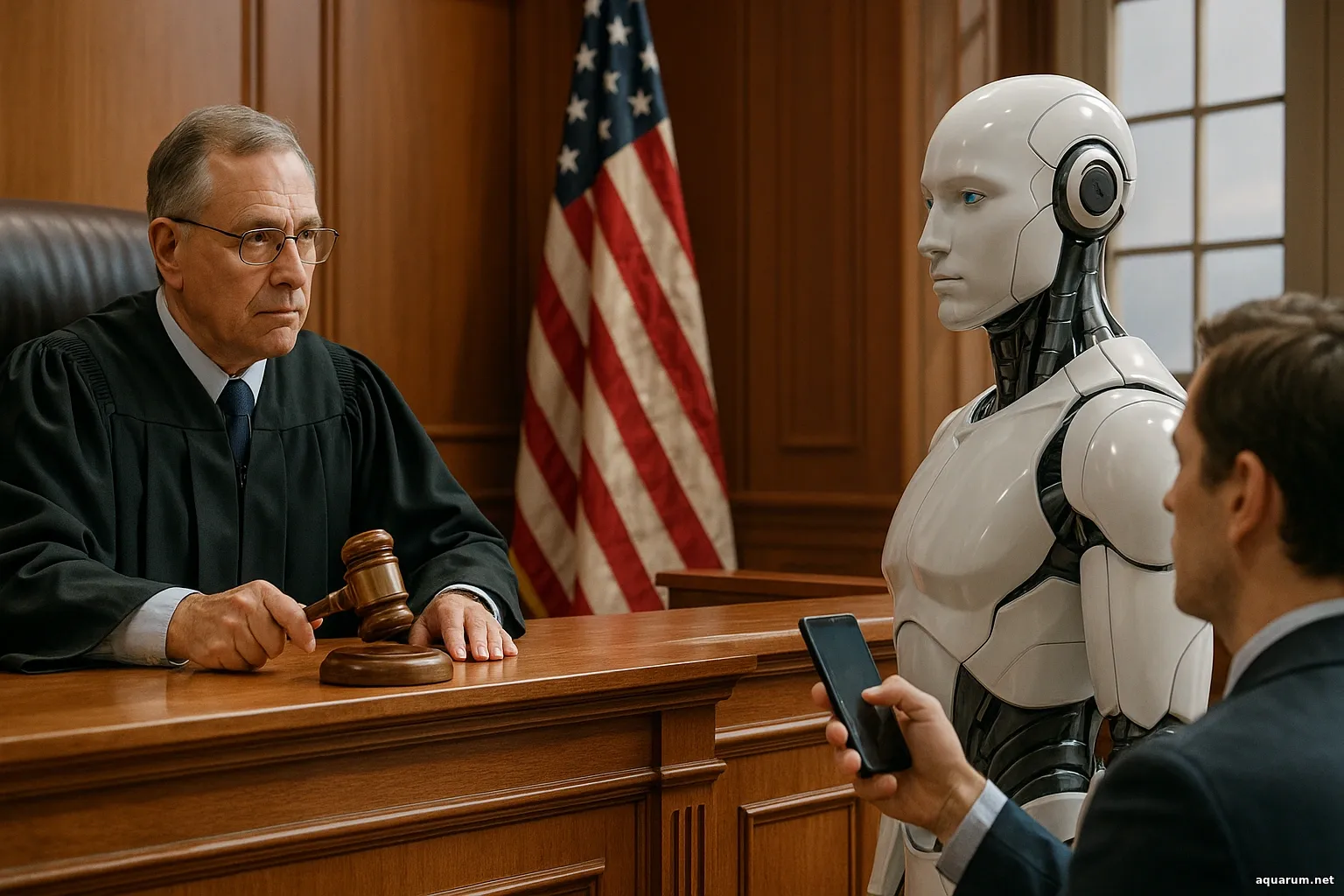

Когда алгоритм становится судьёйПролог: эра невидимого правосудияВсё чаще за решениями, от которых зависят человеческие судьбы, стоит не человек, а программа. Она определяет, кому выдать кредит, кого пригласить на работу, кто достоин условно-досрочного освобождения, а кто должен остаться в тюрьме. Это не футуристический сценарий — это уже реальность. Алгоритмы, созданные для помощи, начинают судить. Они делают это без эмоций, без предвзятости, но и без понимания. Их язык — данные, а не сострадание. Их аргумент — вероятность, а не контекст. Когда алгоритм становится судьёй, общество оказывается на грани нового этапа цивилизации, где правосудие измеряется не моралью, а математикой. И в этом мире возникает вопрос: может ли справедливость быть бездушной, если она построена на точности? Алгоритмическое правосудие: начало новой эпохиТехнологии проникли во все сферы — от медицины до торговли, от искусства до безопасности. Но когда они пришли в сферу права, общество столкнулось с этическим взрывом. Судебная система всегда опиралась на человека: судья — не просто толкователь закона, но и интерпретатор судьбы. Его решения должны учитывать обстоятельства, характер, раскаяние, человеческий контекст. Алгоритм же лишён этой гибкости. Он работает с данными, статистикой, моделями вероятности. Программы, анализирующие судебные дела, уже используются в США, Великобритании, Китае. Они оценивают риск рецидива, прогнозируют поведение обвиняемого, предлагают судье срок наказания. Система COMPAS, внедрённая в некоторых американских судах, анализирует сотни факторов — возраст, социальное окружение, образование, семейное положение — и выдаёт «оценку риска». На основе этого оценочного балла судья принимает решение о мере наказания или освобождении. Так человек получает вердикт, основанный на вероятности, а не на рассказе о своей жизни. Преимущества точности: аргументы сторонниковСторонники алгоритмического правосудия видят в нём шаг к объективности. Человеческий судья подвержен эмоциям, усталости, предвзятости, даже симпатиям и настроению. Алгоритм — нет. Он одинаков для всех. Он не делает различий по цвету кожи, полу, возрасту. Более того, алгоритмы позволяют обработать тысячи дел, где человек просто не успел бы разобраться. Они ускоряют процесс, уменьшают расходы, повышают эффективность. Сторонники этой системы называют её «новым мерилом беспристрастности». Если закон — это формула, почему бы не доверить её исполнение тому, кто умеет считать без ошибок? Но проблема в том, что алгоритм считает не реальность, а то, чему его научили. И если его учитель — человек, он унаследует и человеческие ошибки. Тень предвзятости: когда данные становятся оружиемНа первый взгляд алгоритм кажется нейтральным. Но данные, на которых он обучается, несут отпечаток общества. Если в истории судебных решений определённые группы людей чаще получали суровые приговоры, алгоритм «усвоит» это как закономерность. Он не знает, что это дискриминация — он просто видит повторяющийся шаблон. Так, исследования показали, что система COMPAS чаще присваивала высокий риск рецидива темнокожим обвиняемым, даже если их реальные показатели повторных преступлений были ниже, чем у белых. Это не злой умысел, а отражение статистики прошлого. Алгоритм не умеет сомневаться, не чувствует несправедливости — он просто воспроизводит её с математической точностью. Таким образом, технологии, призванные устранить человеческую предвзятость, могут увековечить её. Когда закон становится кодомТрадиционно правосудие основывалось на тексте — законах, статьях, нормах. Но когда в процесс вмешивается алгоритм, закон превращается в код — последовательность правил, выраженных языком машин. Код точен, но он жёсток. Он не знает исключений, он не понимает иронии судьбы. Юристы начинают сталкиваться с новой реальностью: программный код становится новой формой законодательства. Он не только описывает норму, но и реализует её автоматически. В Китае, например, разрабатываются системы, где искусственный интеллект помогает судьям составлять приговоры. В некоторых административных судах решения формируются алгоритмом, а человек лишь подписывает документ. В будущем, возможно, появятся «смарт-контракты» правосудия, где наказание или оправдание будут зависеть от автоматической проверки условий — как в блокчейне. И тогда вопрос будет стоять не «что сказал закон», а «что вычислил алгоритм». Суд без человека: иллюзия идеальной системыИдея полного устранения человеческого фактора звучит соблазнительно. Она обещает порядок, скорость, беспристрастность. Но правосудие — не только система правил. Это пространство морального выбора. Алгоритм не способен понять раскаяние. Он не различает преступника, совершившего ошибку из отчаяния, и циничного рецидивиста. Он видит только данные. Более того, алгоритм не несёт ответственности. Если человек ошибается, его можно судить, уволить, переучить. Если ошибается программа — кто виноват? Разработчик? Судья, доверивший систему? Государство, купившее её? Когда машина становится судьёй, ответственность растворяется, а решение кажется естественным, как будто данное самой логикой. Но за этой естественностью скрывается новый тип безличной власти. Алгоритмическая справедливость: утопия или новая дисциплинаСегодня во всём мире формируется новая область — этика алгоритмов. Учёные, инженеры, юристы пытаются научить машины быть справедливыми. Они вводят понятия «объяснимый ИИ» и «прозрачность решений». Алгоритмы должны не просто выдавать ответ, но и объяснять, почему он такой. Однако проблема глубже. Даже если мы знаем, как алгоритм принимает решение, понимание не гарантирует справедливости. Ведь справедливость — это не формула. Это баланс между законом и человеческим чувством. Именно здесь возникает философский разлом: можем ли мы измерить мораль так же, как измеряем вероятность? Некоторые эксперты предлагают ввести «человеческий фильтр» — чтобы ни одно автоматическое решение не принималось без рассмотрения судьёй. Другие считают, что нужно обучать алгоритмы этике — через симуляции моральных дилемм, аналогичные философским экспериментам вроде «проблемы вагонетки». Но способен ли код иметь совесть? Алгоритмы вне суда: повседневные приговорыНа самом деле алгоритмическое «судейство» давно вышло за пределы зала суда. — Социальные сети решают, какой контент мы увидим, а какой — нет. Каждый день миллионы людей подвергаются невидимому суду алгоритмов. Они не объявляют приговор, но формируют социальную репутацию — цифровой эквивалент доверия. И в этом цифровом обществе человек постепенно перестаёт быть субъектом, превращаясь в набор характеристик, оценок и скорингов. Великая подмена: от права к предсказаниюСамая опасная трансформация, происходящая сегодня, — это переход от правосудия к прогнозу. Алгоритмы не ждут преступления, они предсказывают его. Программы предиктивной полиции анализируют данные и определяют, где и когда может произойти преступление, кто с большей вероятностью станет нарушителем. Город разделяется на зоны риска, люди — на категории вероятности. Таким образом, правосудие превращается из реакции в предупреждение, а человек — из субъекта закона в объект предсказания. Мир, где алгоритм способен заранее определить, кто опасен, кажется безопаснее. Но в нём исчезает главное — свобода. Ведь свобода невозможна без риска ошибки. Этика будущего: возвращение к человекуМожет ли быть технология справедливой? Может ли машина понимать, что такое милосердие, прощение, случай? Ответ, возможно, не в отказе от алгоритмов, а в новом союзе человека и машины. Алгоритм может быть помощником — тем, кто анализирует данные, ищет закономерности, предлагает варианты. Но решение должно оставаться за человеком, потому что только человек способен сочетать разум и сострадание. Будущее правосудия — не в автоматизации, а в сотрудничестве. Машина помогает видеть закономерности, человек — сохраняет смысл. Технологии не должны заменять совесть. Они должны помогать ей быть точнее. Эпилог: цифровой Фемиде нужен взглядФемида, богиня правосудия, изображается с завязанными глазами — символ беспристрастности. Но в эпоху алгоритмов её повязка становится иной: теперь она — экран. Этот экран способен видеть всё — прошлое, данные, связи, закономерности. Но он не видит взгляд человека. А без этого взгляда правосудие перестаёт быть человеческим. Когда алгоритм становится судьёй, важно помнить: истина не сводится к числам, а справедливость не живёт в коде. Мир может стать точнее, но не станет добрее, если мы забудем, что за каждым набором данных стоит живая история. И, возможно, в будущем настоящим прогрессом станет не создание машины, которая умеет судить, а общества, которое не нуждается в автоматическом судье, потому что научилось понимать справедливость не как формулу, а как дыхание человеческого выбора. |

|

|

| Всього коментарів: 0 | |