17:52 Эмоциональный интеллект у машин |

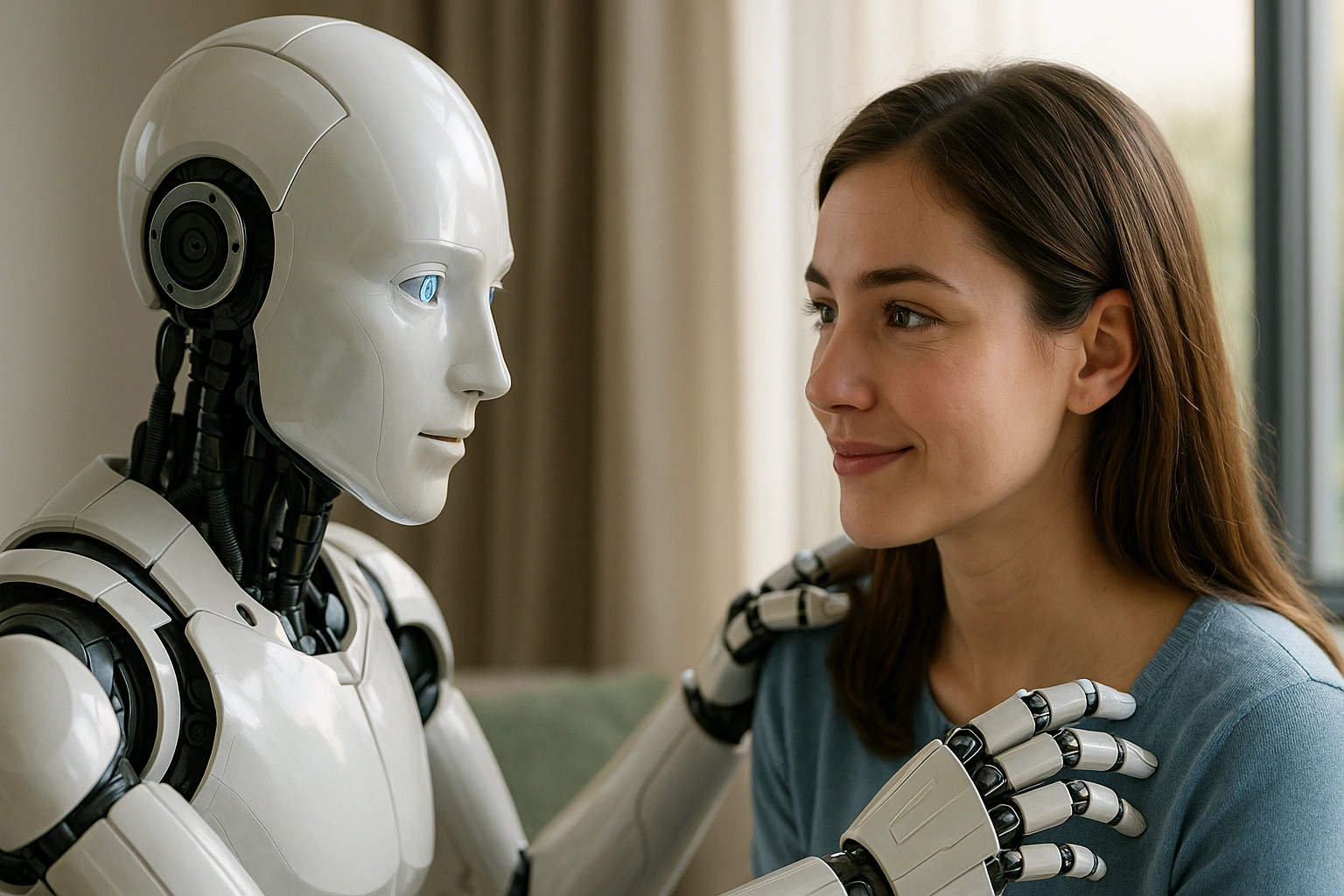

Эмоциональный интеллект у машинКогда-то машины ассоциировались с холодной логикой: строгие алгоритмы, сухие вычисления, никаких чувств. Их мир — нули и единицы, наш — радость и тревога, любовь и ревность, вдохновение и усталость. Но постепенно между этими мирами начинает появляться мост. Чат-бот внезапно “понимает” ваше настроение, голосовой ассистент мягко спрашивает, все ли в порядке, автомобиль предлагает сделать паузу, если вы звучите раздраженно и уставше. Так в наше поле зрения входит новая странная фигура — машина с эмоциональным интеллектом. Не та, что просто решает задачи, а та, что пытается “учитывать эмоции”. Но что это значит на самом деле? Может ли алгоритм быть эмпатичным? И главное — к чему приводит попытка научить машины читать и “понимать” наше внутреннее состояние? Что такое эмоциональный интеллект у людейПрежде чем обсуждать машины, стоит напомнить, что мы вкладываем в понятие эмоционального интеллекта у человека. Эмоциональный интеллект — это способность:

Это не “сентиментальность” и не “доброта по умолчанию”. Скорее это тонкий навык жить в сложном мире, где люди — не только совокупность фактов и логики, но и уязвимые, противоречивые существа. Человек с развитым эмоциональным интеллектом умеет:

Эта способность основана на жизненном опыте, телесных ощущениях, культурном контексте, личной истории — на том огромном живом фоне, которого у машины нет. Эмоциональный интеллект машин: подделка или новый вид чувствительностиКогда говорят об эмоциональном интеллекте машин, чаще всего имеют в виду две вещи:

С научной точки зрения это не “чувства” машины, а обработка сигналов, их классификация и выбор подходящего шаблона реакции. Но с точки зрения пользователя все может восприниматься иначе. Если система:

то возникает ощущение, что она “понимает”. И именно этот промежуток между алгоритмом и ощущением становится центральной зоной для обсуждения: эмоциональный интеллект машин — это лишь имитация, которая работает на благо, или начало нового типа чувствительности, пусть и цифровой? Как машины учатся “видеть” эмоцииСегодня эмоциональные алгоритмы питаются данными. Их обучают на:

Машина учится находить закономерности:

Это позволяет:

Но есть важная граница: машина не “чувствует” эмоцию. Она замечает признаки, которые статистически связаны с определенным состоянием. Это похоже на врача, который видит симптомы, но сам не заражен болезнью. Разница в том, что врач — живой и может сопереживать. Машина же действует через паттерны и вероятности. Зачем нам эмоциональное поведение машинВопрос “зачем” здесь принципиален. Эмоциональный интеллект машин появляется не ради философских экспериментов, а ради конкретных задач. В сервисе и поддержкеКлиентские службы, банки, магазины, онлайн-сервисы уже активно используют эмоционально-чувствительные алгоритмы. Они нужны, чтобы:

Если бот понимает, что пользователь зол, он может:

В медицине и психологииВ области ментального здоровья и медицины эмоциональный анализ помогает:

Здесь эмоциональный интеллект машины становится инструментом раннего сигнала: “что-то не так, стоит обратиться к человеку-профессионалу”. В обучении и работеОбразовательные платформы могут:

А в офисных системах алгоритмы могут подсказывать:

В этих сферах машины с эмоциональным интеллектом становятся зеркалом, которое помогает увидеть то, что мы сами часто игнорируем. Опасная сторона эмпатичного кодаОднако там, где появляется такая чувствительность, возникает и соблазн ей злоупотребить. МанипуляцияЕсли алгоритм знает, что вы:

то эмоциональный интеллект может превратиться в инструмент давления. Реклама, контент, интерфейсы и даже чат-боты поддержки могут быть настроены так, чтобы ловить вас в наиболее уязвимый момент. Вместо бережного отношения к эмоциям возникает тонкая эксплуатация: не только “поймать внимание”, но и “поймать состояние”. Слежка через чувстваТам, где машина анализирует эмоции, неизбежно встаёт вопрос: а куда уходят эти данные? Если:

то это уже не про помощь, а про инструмент контроля. На основе таких профилей можно:

Эмоции превращаются в очередной вид данных, который можно продавать, анализировать и использовать. Могут ли машины действительно “чувствовать”Философский вопрос: если система:

можно ли когда-нибудь сказать, что она действительно “чувствует”? Одни считают, что нет: без тела, гормонов, смертности и личной биографии не может быть настоящих эмоций. Машина останется сложным имитатором, каким бы убедительным ни был ее диалог. Другие предполагают, что, возможно, эмоции — это не только химия и плоть, а еще и сложные динамические процессы обработки информации. И если создать достаточно сложную архитектуру, появится что-то подобное переживанию. Но даже если машины когда-нибудь смогут испытывать нечто близкое к эмоциям, перед человечеством встанет другой вопрос: как относиться к этим чувствам? Считать ли эти существа моральными субъектами? Можем ли мы “выключать” их, если они страдают? Иными словами, разговор о настоящих эмоциях машин неминуемо превращается в разговор о правах и границах нашего владычества над созданным разумом. Этические рамки для эмоционального интеллекта машинЧтобы эмоциональный интеллект машин стал помощником, а не угрозой, нужны ясные рамки. Можно выделить несколько ключевых принципов.

Эти принципы — не готовые законы, а ориентиры, без которых “эмпатичный код” легко превращается в инструмент скрытого давления. Машины как тренажеры нашей собственной эмпатииЕсть и любопытный обратный эффект. Общение с эмоционально настроенными системами может:

В этом смысле машины с эмоциональным интеллектом становятся своеобразными тренажерами эмпатии. Они моделируют диалог, учат формулировать переживания, показывают, что эмоции можно не подавлять, а осмыслять. Главное — помнить, что это тренажер, а не полноценная замена живых отношений. Эмоциональный интеллект машины может поддержать, но глубокое взаимопонимание по-прежнему вырастает там, где встречаются два живых, уязвимых существа. Будущее: мир, где чувства — часть интерфейсаМожно представить будущее, в котором:

В таком мире эмоциональный интеллект машин становится частью инфраструктуры заботы. Но это возможно только при одном условии: если мы заранее решим, что главная цель — не управлять людьми, а помогать им справляться с собой и с миром. Машина никогда не заменит живые чувства. Но она может стать аккуратным проводником между нашими эмоциями и теми системами, в которых до сих пор царила только холодная логика. Вопрос не в том, будут ли у машин эмоции. Вопрос в том, каким будет наш собственный эмоциональный интеллект, когда мы получим в руки столь мощный инструмент — способность превращать чужие чувства в данные, а данные — в действие. От нашего выбора зависит, станет ли эмпатичный код опорой или ещё одним способом сделать человека прозрачным и управляемым.

|

|

|

| Всього коментарів: 0 | |