18:47 Почему роботы не понимают насмешку |

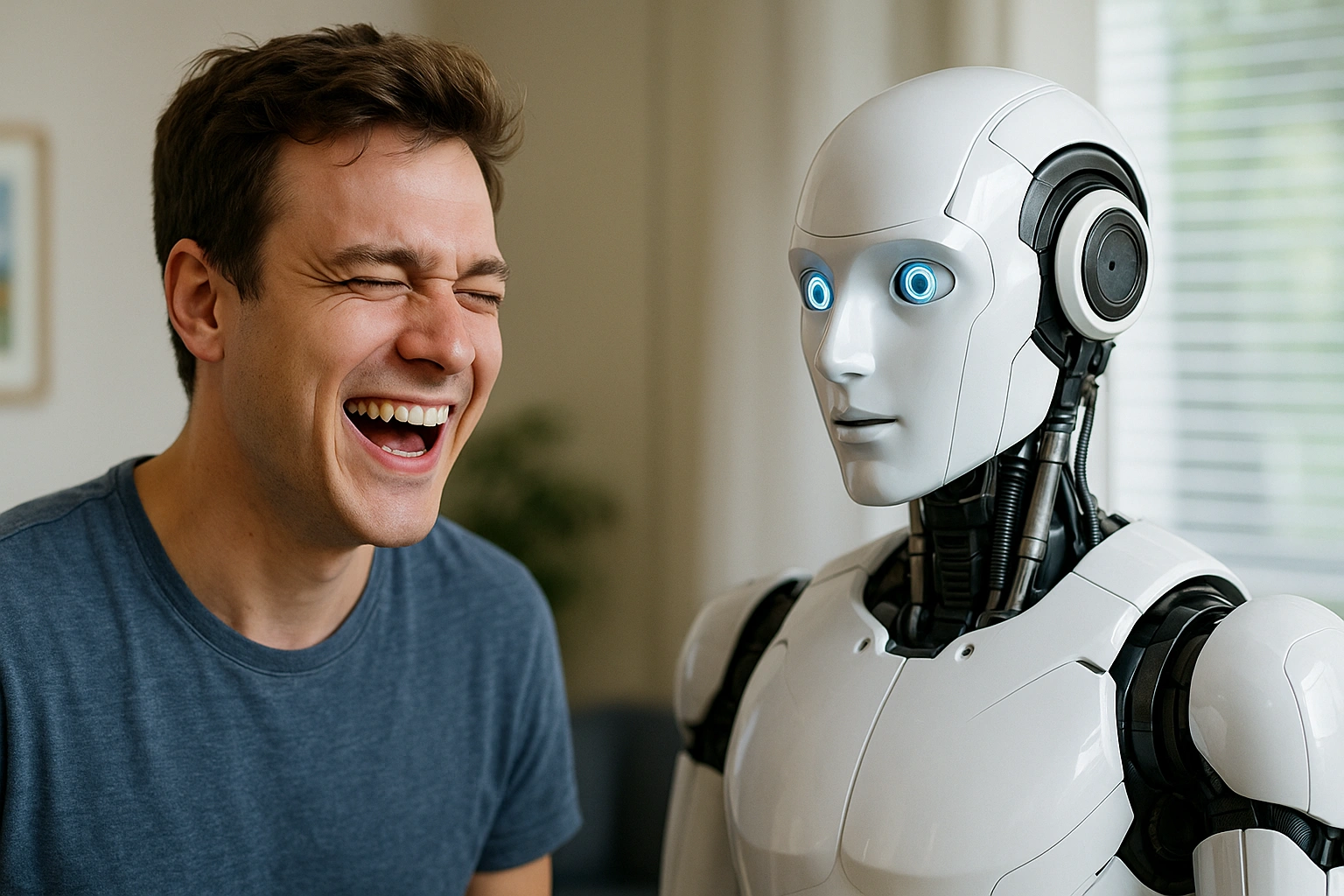

Почему роботы не понимают насмешкуПредставьте диалог: — Ну да, ты просто гений, как всегда. Первый собеседник фыркает, закатывает глаза, голосом режет. Второй — улыбается искренне, не почувствовав удара. Если заменить второго на робота или умного ассистента, картинка почти не изменится: он тоже “обрадуется” похвале, честно воспримет слова как комплимент и, возможно, даже поблагодарит. Именно здесь становится особенно заметно: что-то важное в человеческой коммуникации машинным системам ускользает. Они уже умеют переводить тексты, писать стихи, ставить диагнозы, планировать логистику. Но одна простая фраза, сказанная с определенной интонацией, превращает их в наивных чужаков, которые не улавливают очевидного подтекста. Почему так устроено? Почему насмешка, ирония и сарказм остаются почти непроходимым лабиринтом для машин, даже когда они убеждают нас в своей “разумности”? Насмешка как лед и подледный потокЧеловеческая речь — это не только значение слов. Это еще и тон, паузы, выражение лица, ситуация, общий контекст отношений. Насмешка особенно коварна: на поверхности она часто маскируется под комплимент, поддержку или нейтральную реплику. “Ну да, ты так готовился, сразу видно” Слова могут быть положительными, но под ними — ледяной поток раздражения, обиды, превосходства. Срабатывают не смыслы по словарю, а:

Насмешка — это язык намеков. Она редко произносит прямо то, что имеет в виду. Ее фундамент — “мы оба понимаем, что здесь сказано не то, что сказано”. Это сговор двоих или группы людей, основанный на общем опыте. Робот же, даже самый продвинутый, видит прежде всего текст и сигналы, которые ему удалось связать со статистикой. Там, где человек чувствует укол, система видит набор слов, похожий на комплимент. Как машины “понимают” язык на самом делеЧтобы понять, почему насмешка ускользает, нужно на секунду заглянуть в то, как современные системы вообще работают с языком. Машины обучаются:

Они не ощущают смыслы, а вычисляют вероятности:

Насмешка же строится на поломке этих ожиданий. Она специально выбирает положительные слова там, где человек испытывает негатив; использует шаблон похвалы в ситуации, где на самом деле звучит упрек. Для статистики это шум, редкая комбинация. Для живого собеседника — почти физический удар. Чего роботу не хватает до понимания насмешкиДаже если алгоритмы научатся немного лучше ловить интонацию и “подвох” фраз, им все равно будет сложно по целому ряду причин. 1. Нет телесного опытаНасмешка — это не только про язык, но и про опыт быть уязвимым. Человек знает, каково это:

Этот опыт прописывается в теле: сжатые плечи, тяжесть в животе, ком в горле. На этом фоне мы учимся различать оттенки: где легкая шутка, а где унижение, где ирония от обиды, а где — от любви и доверия. У робота нет памяти унижений, стыда, страха быть отвергнутым. Ему не больно от насмешки. Он может классифицировать фразу как “саркастическую”, но не проживает ее как опасность или рану. А без этого важно что-то ускользает: понимание, зачем люди этим вообще занимаются. 2. Нет настоящей “социальной кожи”Насмешка живет на границе отношений: кто над кем смеется, кто старше, кто слабее, кто привык терпеть, а кто — нападать. Для распознавания нужен не только текст, но и карта невидимых линий:

Машина может знать: пользователь А общается с пользователем Б. Но она почти не чувствует угрозы или безопасности в этих отношениях. Для нее это два идентификатора. Для нас — начальник и подчиненный, родитель и подросток, старый друг и новый знакомый. Та же фраза “Ну да, конечно” в устах близкого друга может звучать ласково, а в устах начальника — унизительно. Роботу нечем измерить эту разницу, кроме косвенных, часто бедных сигналов. 3. Насмешка — это игра контекстом, а контекст бесконеченЧтобы по-настоящему понять насмешку, нужно помнить:

Контекст может тянуться годами. Ирония иногда опирается на одну давнюю фразу, которую помнят только двое. Люди иногда строят насмешку как продолжение многосерийного диалога длиной в жизнь. Машины же живут, в лучшем случае, в рамках окна контекста: нескольких реплик, документа, сессии. Да, им помогают лог-файлы, история переписок, базы данных, но объединить это в живое, цельное “наше прошлое” они не могут. Для насминутной перебранки мы легко вытягиваем нить из пяти лет дружбы. Для робота это хаос разношерстных данных. Почему даже людям трудно с насмешкой — и что это говорит о машинахИногда, чтобы понять, насколько сложна задача, достаточно посмотреть на нас самих. Люди:

Если живое существо с богатым телесным опытом, эмоциональной памятью и культурной интуицией регулярно ошибается, представить уровень сложности для машины становится проще. Она видит только вершину айсберга — слова, иногда голос, иногда картинку — и пытается догадаться о глубине. Попытки научить машины улавливать сарказмНесмотря на все сложности, люди упорно пытаются научить алгоритмы хотя бы технически различать насмешку.

Иногда это работает на уровне “вероятно, здесь сарказм”. Модели научаются:

Но это лишь техническая надстройка. Алгоритм не “осуждает” насмешку, не чувствует ее несправедливость или юмор. Он относится к ней как к еще одному классу данных: нейтральный, позитивный, негативный, саркастический. Опасности недопонимания: когда робот верит словамПока роботы не понимают насмешку, возникают очень человеческие, но весьма приземленные риски.

С другой стороны, слишком “нервный” алгоритм, наоборот, начнет маркировать любую иронию как токсичность, убивая живую, иногда очень терапевтичную способность людей посмеяться над собой и друг другом без злобы. Нужно ли вообще учить роботов понимать насмешкуЗдесь возникает принципиальный вопрос. Может быть, не стоит стремиться к тому, чтобы искусственные системы понимали все оттенки человеческих игр? Аргументы “за”:

Аргументы “против”:

Возможно, золотой путь — не в том, чтобы машины стали “экспертами по насмешке”, а в том, чтобы они лучше помогали людям замечать опасные ситуации, передавая им сигнал: “здесь может быть проблема, присмотрись”. Роботы как вечные чужакиВ насмешке есть одна черта, которая делает ее по-настоящему человеческой: она всегда про “своих” и “чужих”. Мы мгновенно считываем, смеются ли с нами или над нами, создают ли шуткой мост или стену. Роботы в этой картине пока почти всегда — чужаки. Они не знают, каково это — быть объектом насмешки, не помнят ночей, когда чья-то фраза “в шутку” не давала уснуть, не умеют осторожно обходиться с чужой уязвимостью. В лучшем случае они могут выучить правила приличия и автоматически сглаживать углы. Может быть, именно это и неплохо. Мы создаем машин, чтобы они были надежными, предсказуемыми, честными. Возможно, в мире, где так много боли от человеческой насмешливости, полезно иметь рядом существа, которые воспринимают слова буквально и не пытаются уколоть в ответ. Вместо вывода: зеркала и маскиИстория о том, почему роботы не понимают насмешку, — это не только рассказ о слабостях технологий. Это еще и зеркало, в котором видно, насколько сложен наш собственный язык. Мы привыкли прятать обиду в сарказм, безразличие — в шутку, агрессию — в “иронию”. Мы играем масками и ждем, что близкие люди догадаются, где в нас — боль, а где — юмор. Машины, сталкиваясь с этим, честно признаются: “мы не понимаем”. И в этом признании есть неожиданная честность. Пока роботы учатся различать хотя бы грубый сарказм и явную насмешку, нам самим есть чем заняться: лучше понимать, как наши слова ранят, чем отличается добрая ирония от язвительности, зачем мы вообще смеемся над теми, кто слабее. И, возможно, однажды, когда машины станут чуточку чувствительнее к подтекстам, нам придется очень внимательно подумать, чему именно мы хотим их научить: замечать насмешку, чтобы защищать, или копировать ее, чтобы еще одна форма интеллекта овладела этим древним человеческим оружием.

|

|

|

| Всього коментарів: 0 | |